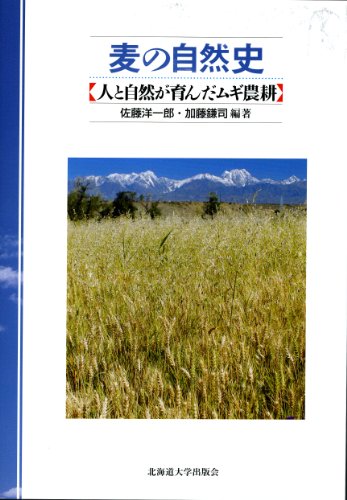

1 0 0 0 麦の自然史 : 人と自然が育んだムギ農耕

- 著者

- 佐藤洋一郎 加藤鎌司編著

- 出版者

- 北海道大学出版会

- 巻号頁・発行日

- 2010

1 0 0 0 染色〜色の不思議 : 志村ふくみ, 洋子・佐藤洋一郎

- 著者

- [志村ふくみ 志村洋子 佐藤洋一郎監修]

- 出版者

- 紀伊國屋書店

- 巻号頁・発行日

- 2010

1 0 0 0 行動履歴を反映させた適応的環境属性を伴う三次元人物追跡

- 著者

- 杉村 大輔 小林 貴訓 佐藤洋一 杉本 晃宏

- 出版者

- 一般社団法人情報処理学会

- 雑誌

- 情報処理学会研究報告コンピュータビジョンとイメージメディア(CVIM) (ISSN:09196072)

- 巻号頁・発行日

- vol.2006, no.115, pp.171-178, 2006-11-10

- 被引用文献数

- 2

パーティクルフィルタを用いた人物追跡技術は,これまでに様々な手法が提案され その有用性が報告されている.一方で,追跡の安定化に有効な 画像以外の手がかりとして,環境属性情報がある.環境属性情報とは,対象シーン内の人物の存在可能性を意味し,これを追跡に利用することで人物が存在しにくい箇所への仮説の生成を抑制することができる. したがって環境属性情報は 効率的な仮説の生成に役立つと考えられる.この指標には,障害物の配置などの物理的な制約に依るもの,人物の行動履歴に依るものがある.本研究で提案する手法では,特に後者に焦点を当て,環境属性情報の獲得と追跡の枠組みへの統合を行う.具体的には,環境属性情報を混合正規分布で表現し,オンラインEMアルゴリズムにより人物行動履歴を逐次的に学習することで獲得する.さらに,ICONDENSATION の考えに基づき,追跡の枠組みに統合する. 実環境における実験により 本手法の有効性を確認した.Various tracking techniques based on particle filters have been proposed. To enhance the robustness of tracking, it is very significant to consider environmental attributes which represent an existing probability of people in a scene. They can be used for an effective hypothesis generation by considering the area where people are likely to exist. The environmental attributes can be considered in two aspects: the one is based on the physical configuration of objects in a scene and the other is based on the history of people activities. In this paper, we establish the history based environmental attributes that are updated by people tracking result everyframe using the online EM algorithm. Furthermore, we incorporate them into our tracking algorithm by using the ICONDENSATION framework. Our experimental results demonstrate the effectiveness of our method.

1 0 0 0 物体の陰影に基づく光源環境の推定

- 著者

- 佐藤いまり 佐藤洋一 池内 克史

- 出版者

- 一般社団法人情報処理学会

- 雑誌

- 情報処理学会論文誌コンピュータビジョンとイメージメディア(CVIM) (ISSN:18827810)

- 巻号頁・発行日

- vol.41, no.10, pp.31-40, 2000-12-15

- 被引用文献数

- 15

室内など,一般の照明環境のもとでは,物体からおとされる影は明確な輪郭線を持たないソフトシャドウとして観察される.本報告では,このソフトシャドウ内の明るさ分布を利用することで,実照明の光源分布を推定する手法を提案する.提案される手法では,まず実世界の光源環境を空間的に均等なサンプリング方向の光源輝度の総和として近似する.次に光源輝度分布と画像面に観察されるシャドウの明るさの関係式に基づき,シャドウ内の各画素より各光源サンプリング方向の光源輝度が未知数となるような方程式を導く.最後にシャドウ内の画素より導かれた連立方程式を解くことにより,各サンプリング方向の光源輝度を推定する.このようにして推定された光源輝度分布を用いることにより,実世界と仮想世界の光学的整合性を実現し,違和感なく仮想物体を実画像に重ね込むことが可能となる.In this paper, we propose a new method for estimating the illumination distribution of a real scene from image brightness observed on a real object surface in that scene. More specifically, we recover the illumination distribution of the scene from a radiance distribution inside shadows cast by an object of known shape onto another object surface of known shape and reflectance. The approach employed in this study is as follows. The illumination distribution of a scene is first approximated by discrete sampling of an extended light source; whole distribution is represented as a set of point sources equally distributed in the scene. Then this approximation leads each image pixel inside shadows to provide a linear equation with unknown radiance of those sources. Finally, unknown radiance of each source is solved from the obtained set of equations. By using the occlusion information of the incoming light, we are able to reliably estimate the illumination distribution of a real scene, even in a complex illumination environment. The estimated illumination distribution is then used for rendering virtual objects superimposed onto images of the real scene.

1 0 0 0 分散センサ情報の統合によるエリア内人物追跡と動線推定

- 著者

- 小林 貴訓 佐藤洋一

- 出版者

- 一般社団法人情報処理学会

- 雑誌

- 情報処理学会研究報告コンピュータビジョンとイメージメディア(CVIM) (ISSN:09196072)

- 巻号頁・発行日

- vol.2008, no.36, pp.231-246, 2008-05-01

- 被引用文献数

- 3

本稿では,環境に疎密に分散配置されたセンサ群を用いて,特定エリア全体における人物動線を計測する手法について述べる.まず,公共施設や商業施設などの監視カメラ映像を想定し,視野を共有する複数のカメラを用いて,人物頭部の三次元位置と向きを追跡する手法について述べる.また,店舗などでの複数人物の追跡のため,監視カメラによる追跡にレーザ測域センサを相補的に統合することで,人物の出現や消失の検出,人物相互の遮蔽を扱う.さらに,エリア内全体を通じて,連続した人物動線を計測するため,障害物や人物相互の遮蔽などにより断片化した人物動線や,複数観測領域間における人物動線を対応付け,観測領域外の人物動線を補間する手法について述べる.This paper describes the method of tracking people in an indoor environment by using a sparse network of multiple sensors. 3D position and the orientation of people's heads are tracked by using multiple cameras. To deal with appearance/disappearance of people including occlusions cased by people's interactions, laser range scanners are seamlessly integrated into the vision based tracking framework. The information from a sparse network of multiple sensors is used to estimate people's trajectories in the whole area including unobserved areas. This paper also describes the method for establishing correspondences between trajectories captured by different cameras and estimating trajectories in unobserved areas.