- 著者

- 伊藤 洋 Simon Armleder 鹿田 玄輝 蔡 賢博 Gordon Cheng 尾形 哲也

- 雑誌

- 2023年度 人工知能学会全国大会(第37回)

- 巻号頁・発行日

- 2023-04-06

3 0 0 0 深層予測学習を用いたロボット動作の複合生成

- 著者

- 鈴木 彼方 伊藤 洋 山田 竜郎 加瀬 敬唯 尾形 哲也

- 出版者

- 一般社団法人 日本ロボット学会

- 雑誌

- 日本ロボット学会誌 (ISSN:02891824)

- 巻号頁・発行日

- vol.40, no.9, pp.772-777, 2022 (Released:2022-11-18)

- 参考文献数

- 26

- 著者

- 尾形 哲也 菅野 重樹

- 出版者

- 一般社団法人日本機械学会

- 雑誌

- 日本機械学會論文集. C編 (ISSN:03875024)

- 巻号頁・発行日

- vol.65, no.633, pp.1900-1906, 1999-05-25

- 被引用文献数

- 16

This study discusses the communication between autonomous robots and humans through the development of a robot which has an emotion model. The model refers to the internal secretion system of humans and it has four kinds of the hormone parameters to use to adjust various internal conditions such as motor output, cooling' fan output and sensor gain. We surveyed 126 visitors at '97 International Robot Exhibition held in Tokyo (Oct. 1997) in order to exaluate psychological impressions of the robot. As the result, the human friendliness of the robot was confirmed and some factors concerning with the human robot emotional communication were discovered.

2 0 0 0 IR 内分泌系を参考としたロボットの感情モデルに関する研究

2 0 0 0 OA RNNを備えた2体のロボット間における身体性に基づいた動的コミュニケーションの創発

- 著者

- 日下 航 尾形 哲也 小嶋 秀樹 高橋 徹 奥乃 博

- 出版者

- 一般社団法人 日本ロボット学会

- 雑誌

- 日本ロボット学会誌 (ISSN:02891824)

- 巻号頁・発行日

- vol.28, no.4, pp.532-543, 2010 (Released:2012-01-25)

- 参考文献数

- 29

- 被引用文献数

- 1

We propose a model of evolutionary communication with voice signs and motion signs between two robots. In our model, a robot recognizes other's action through reflecting its self body dynamics by a Multiple Timescale Recurrent Neural Network (MTRNN). Then the robot interprets the action as a sign by its own hierarchical Neural Network (NN). Each of them modifies their interpretation of signs by re-training the NN to adapt the other's interpretation throughout interaction between them. As a result of the experiment, we found that the communication kept evolving through repeating miscommunication and re-adaptation alternately, and induced the emergence of diverse new signs that depend on the robots' body dynamics through the generalization capability of MTRNN.

2 0 0 0 多重奏楽曲の楽器音量バランス変化による音楽ジャンルシフト

- 著者

- 糸山 克寿 後藤 真孝 駒谷 和範 尾形 哲也 奥乃 博

- 出版者

- 情報処理学会

- 雑誌

- 研究報告音楽情報科学(MUS) (ISSN:09196072)

- 巻号頁・発行日

- vol.2009, no.3, pp.1-6, 2009-07-22

本報告では,楽曲の楽器パート音量操作によってユーザがクエリをカスタマイズすることが可能な類似楽曲検索手法を提案する.楽曲の雰囲気やジャンルは楽曲を構成する楽器およびその音量バランスと強く関係する,という仮説に基づく.楽曲の音響信号を楽譜に基づいて楽器パートへと分離し,その分離信号の音量を操作することで楽曲の音響的特徴を変化させる.楽曲の音響特徴はガウス混合分布で表現され,楽曲間の類似性を分布間の Earth Movers Distance で定義する.実験により,歌声,ギター,ドラムスパートの音量を操作した際にジャンルシフトが起こることを示す.This report presents a novel Query-by-Example (QBE) approach in Music Information Retrieval, which allows a user to customize query examples by directly modifying the volume of different instrument parts. The underlying hypothesis is that the musical genre shifts (changes) in relation to the volume balance of different instruments. Our QBE system first separates the musical audio signal into all instrument parts with the help of its musical score, and then lets a user remix those parts to change acoustic features that represent musical mood of the piece. The distribution of those features is modeled by the Gaussian Mixture Model for each musical piece, and the Earth Movers Distance between mixtures of different pieces is used as the degree of their mood similarity. Experimental results showed that the shift was actually caused by the volume change of vocal, guitar, and drums.

2 0 0 0 OA 巻頭言「身体のない知能」

- 著者

- 尾形 哲也 早稲田大学産業技術総合研究所

- 雑誌

- 人工知能

- 巻号頁・発行日

- vol.32, 2017-09-01

2 0 0 0 音響特徴・ベース音・和音遷移を用いた自動和音認識

- 著者

- 糸山 克寿 尾形 哲也 奥乃 博

- 雑誌

- 研究報告音楽情報科学(MUS)

- 巻号頁・発行日

- vol.2012, no.29, pp.1-7, 2012-01-27

本稿では,多重奏音楽音響信号に対する自動和音和音手法について述べる.和音の認識においては,音楽的要素の関連性を考慮することが重要である.我々は,和音を表現する音響特徴であるクロマベクトルに加えて和音と関わりの深い音楽的要素であるベース音を用いた自動和音認識手法を構築した.和音遷移のパターンを事前に階層 Pitman-Yor 言語モデルで学習し,Viterbi アルゴリズムに基づく最大事後確率推定で和音系列を推定する.Beatles の 150 楽曲を用いた評価実験で,本手法は 73.7% の認識率を達成した.This paper describes a method that identifies musical chords in polyphonic musical signals. As musical chords mainly represent the harmony of music and are related to other musical elements such as melody and rhythm, we should be able to recognize chords more effectively if this interrelationship is taken into consideration. We use bass pitches as clues for improving chord recognition. The proposed chord recognition system is constructed based on Viterbi-algorithm-based maximum a posteriori estimation that uses a posterior probability based on chord features, chord transition patterns, and bass pitch distributions. Experimental results with 150 Beatles songs that has keys and no modulation showed that the recognition rate was 73.7% on average.

2 0 0 0 OA ぺた語義:京大における Lisp を使ったプログラミング教育

1 0 0 0 OA 特集「発声と音声認知のメカニズムの理解を目指して」に寄せて

- 著者

- 尾形 哲也

- 出版者

- バイオメカニズム学会

- 雑誌

- バイオメカニズム学会誌 (ISSN:02850885)

- 巻号頁・発行日

- vol.33, no.4, pp.224, 2009 (Released:2016-04-19)

1 0 0 0 OA 神経力学モデルによる予測可能性を用いた身体識別

認知ロボティクスにおいて身体図式の獲得は重要なテーマの一つである。従来研究では運動指令値と視覚を相関学習させるため,視覚中の身体位置が既知であることが前提であった。対して本手法は「予測(操作) できる部分が身体である」という考えに基づき、運動指令値と視覚の関係を予測学習することによって画像中の他者と自己の身体識別を可能とした。具体的には神経力学モデルであるMTRNN に運動指令値及び自己と他者の身体を含む視覚情報を入力し予測学習させ,予測可能部分を自己身体とした。実験の結果,MTRNN は運動指令値のみから自己身体を他者身体に比べ平均10 倍の精度で予測できることが確認された。

1 0 0 0 音色の音高依存性を考慮した楽器音の音高操作手法

- 著者

- 安部 武宏 糸山克寿 吉井 和佳 駒谷 和範 尾形 哲也 奥乃 博

- 雑誌

- 情報処理学会論文誌 (ISSN:18827764)

- 巻号頁・発行日

- vol.50, no.3, pp.1054-1066, 2009-03-15

- 被引用文献数

- 1

本稿では,ある音高を持つ楽器音をもとにして,音色の歪みを抑えながら任意の音高を持つ楽器音を合成する手法について述べる.我々は音色の聴感上の差に関する音響心理学的知見に基づき,楽器音のスペクトログラム上で観察される音色特徴量として,(i) 倍音ピーク間の相対強度,(ii) 非調波成分の分布,(iii) 時間方向の振幅エンベロープの3つを定義する.まず,もとになる楽器音の音色特徴量を分析するため,糸山らの調波·非調波統合モデルを用いて楽器音を調波構造と非調波構造に分離する.音高操作時には,特徴量(i),(ii) の音高依存性を考慮しなければならない.そのため,音高に対する特徴量を3次関数で近似し,所望の音高における特徴量の値を予測する.32種類の楽器に対して音高操作を試みたところ,音高依存性を考慮しない場合と比べて合成音と実際の楽器音との距離が,スペクトル距離尺度では64.70%,MFCC距離尺度では32.31%減少し,手法の有効性が確かめられた.This paper presents a synthesis method that can generate musical instrument sounds with arbitrary pitches from a given musical instrument sound while constraining distorting timbral characteristics. Based on the psychoacoustical knowledge on auditory effects of timbre, we define timbral features on the spectrogram of a musical instrument sound as (i) relative amplitudes of harmonic components, (ii) distribution of inharmonic components, and (iii) temporal envelopes of harmonic components. First, to analyze timbral features of a seed, it is separated into harmonic and inharmonic components by using Itoyama's integrated model. In pitch manipulation, it is necessary to take into account the relation of pitch and features (i) and (ii). Therefore, we predict the values of each feature by using a cubic polynomial that approximates the feature distribution over pitches. Experimental results showed the effectiveness of our method; the spectral and MFCC distances between synthesized sounds and real sounds of 32 instruments were reduced by 64.70% and 32.31%, respectively.

1 0 0 0 OA 神経回路モデルによるロボットの行動と言語の統合学習

- 著者

- 尾形 哲也

- 出版者

- 公益社団法人 計測自動制御学会

- 雑誌

- 計測と制御 (ISSN:04534662)

- 巻号頁・発行日

- vol.55, no.10, pp.872-877, 2016 (Released:2016-10-20)

- 参考文献数

- 23

- 被引用文献数

- 4

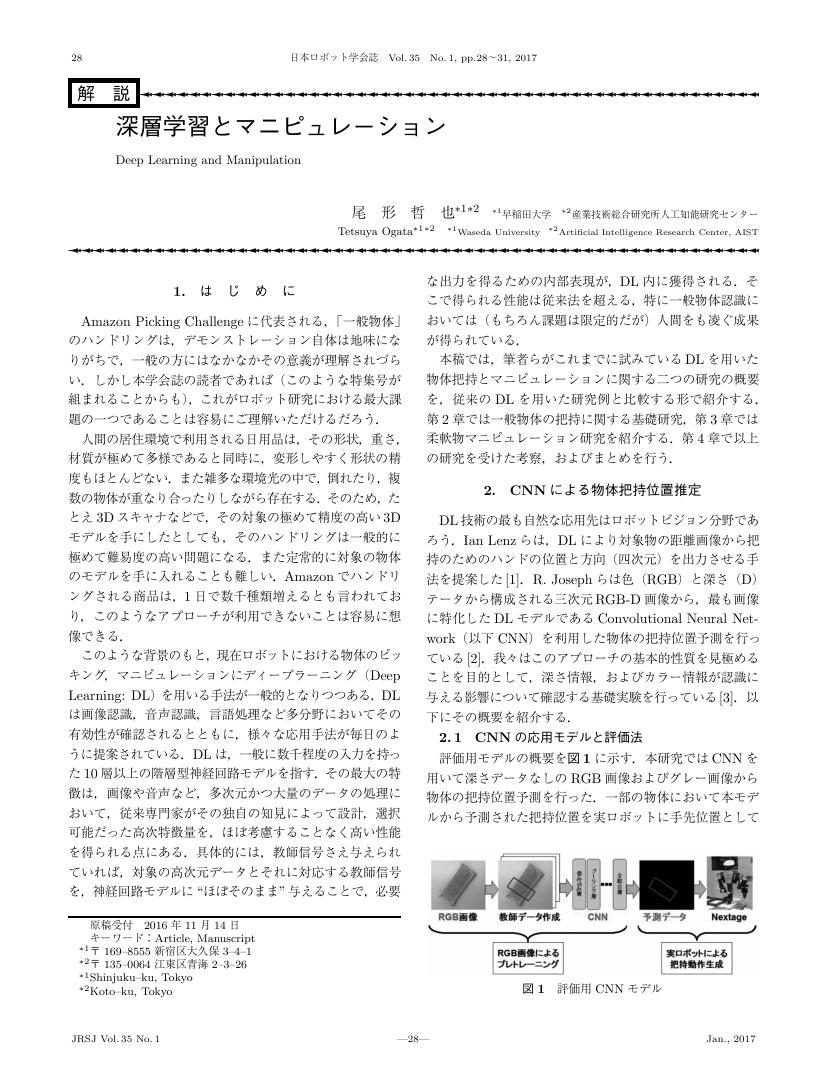

1 0 0 0 OA 深層学習とマニピュレーション

- 著者

- 尾形 哲也

- 出版者

- 一般社団法人 日本ロボット学会

- 雑誌

- 日本ロボット学会誌 (ISSN:02891824)

- 巻号頁・発行日

- vol.35, no.1, pp.28-31, 2017 (Released:2017-02-15)

- 参考文献数

- 9

- 被引用文献数

- 6 4

1 0 0 0 OA 深層予測学習によるロボット動作学習 —エクスペリエンス・ベースド・ロボティクス—

- 著者

- 尾形 哲也

- 出版者

- 一般社団法人 日本ロボット学会

- 雑誌

- 日本ロボット学会誌 (ISSN:02891824)

- 巻号頁・発行日

- vol.38, no.6, pp.516-520, 2020 (Released:2020-07-29)

- 参考文献数

- 10

- 被引用文献数

- 1

1 0 0 0 OA 音声対話システムにおける音韻的類似表現の混同を防ぐための確認の自動生成

- 著者

- 浜辺 良二 駒谷 和範 尾形 哲也 奥乃 博

- 雑誌

- 情報処理学会研究報告自然言語処理(NL)

- 巻号頁・発行日

- vol.2005, no.50(2005-NL-167), pp.89-94, 2005-05-27

音声対話システムにおいて,聞き取りやすさを考慮したシステム応答側の発話内容や言語表現についてはほとんど研究されていない.本研究では,システムの語彙内の音韻的に類似した単語に対して,それらを聞き分けやすくする新たな単語を付加した確認を自動的に生成する.まず,複数の知識源を利用して,付加する単語の候補を複数取得する.さらに確認の適切性を測る尺度を定義することにより,候補から最適な確認表現を自動的に選択する.京都市バス運行情報システムおよびホテル検索システムの語彙に対して,本手法により確認を生成し評価を行った.被験者5名に対する聴取実験により,生成した確認によって音韻的に類似した単語の聞き分けが改善されることを確認し,本手法の有効性を示した.

1 0 0 0 OA 情動モデルを有する自律ロボットWAMOEBA-2(ワメーバ)と人間との情緒交流

- 著者

- 尾形 哲也 菅野 重樹

- 出版者

- 一般社団法人 日本機械学会

- 雑誌

- 日本機械学会論文集 C編 (ISSN:03875024)

- 巻号頁・発行日

- vol.65, no.633, pp.1900-1906, 1999-05-25 (Released:2008-02-26)

- 参考文献数

- 16

- 被引用文献数

- 1

This study discusses the communication between autonomous robots and humans through the development of a robot which has an emotion model. The model refers to the internal secretion system of humans and it has four kinds of the hormone parameters to use to adjust various internal conditions such as motor output, cooling' fan output and sensor gain. We surveyed 126 visitors at '97 International Robot Exhibition held in Tokyo (Oct. 1997) in order to exaluate psychological impressions of the robot. As the result, the human friendliness of the robot was confirmed and some factors concerning with the human robot emotional communication were discovered.

1 0 0 0 OA ソフトロボティクスと身体知

- 著者

- 中川 友紀子 石黒 章夫 尾形 哲也 多田隈 理一郎 細田 耕

- 出版者

- 日本知能情報ファジィ学会

- 雑誌

- 知能と情報 (ISSN:13477986)

- 巻号頁・発行日

- vol.29, no.5, pp.160-172, 2017-10-15 (Released:2019-10-15)

- 参考文献数

- 5

1 0 0 0 OA 環境音を対象とした擬音語自動認識 擬音語表現における音素決定曖昧性の解消

- 著者

- 石原 一志 駒谷 和範 尾形 哲也 奥乃 博

- 出版者

- 一般社団法人 人工知能学会

- 雑誌

- 人工知能学会論文誌 (ISSN:13460714)

- 巻号頁・発行日

- vol.20, no.3, pp.229-236, 2005 (Released:2005-03-23)

- 参考文献数

- 13

- 被引用文献数

- 2 2

Environmental sounds are very helpful in understanding environmental situations and in telling the approach of danger, and sound-imitation words (sound-related onomatopoeia) are important expressions to inform such sounds in human communication, especially in Japanese language. In this paper, we design a method to recognize sound-imitation words (SIWs) for environmental sounds. Critical issues in recognizing SIW are how to divide an environmental sound into recognition units and how to resolve representation ambiguity of the sounds. To solve these problems, we designed three-stage procedure that transforms environmental sounds into sound-imitation words, and phoneme group expressions that can represent ambiguous sounds. The three-stage procedure is as follows: (1) a whole waveform is divided into some chunks, (2) the chunks are transformed into sound-imitation syllables by phoneme recognition, (3) a sound-imitation word is constructed from sound-imitation syllables according to the requirements of the Japanese language. Ambiguity problem is that an environmental sound is often recognized differently by different listeners even under the same situation. Phoneme group expressions are new phonemes for environmental sounds, and they can express multiple sound-imitation words by one word. We designed two sets of phoneme groups: ``a set of basic phoneme group'' and ``a set of articulation-based phoneme group'' to absorb the ambiguity. Based on subjective experiments, the set of basic phoneme groups proved more appropriate to represent environmental sounds than the articulation-based one or a set of normal Japaneses phonemes.

1 0 0 0 OA 擬音語自動認識に基づいた環境音検索システム

- 著者

- 石原 一志 駒谷 和範 尾形 哲也 奥乃 博

- 雑誌

- 第67回全国大会講演論文集

- 巻号頁・発行日

- vol.2005, no.1, pp.371-372, 2005-03-02